실제 얼굴보다 ‘더 믿을 만한 얼굴’ 평가

합성 얼굴이 평균에 더 가깝기 때문인 듯

진짜를 방불케 하는 가짜 이미지나 목소리를 합성해내는 딥페이크 기술이 위험 수위를 넘어서고 있다.

인공신경망 알고리즘이 만들어낸 사람 얼굴이 실제와 구별할 수 없을 정도로 사실적인 것을 넘어, 실제 얼굴보다 오히려 더 신뢰감을 주는 데까지 나아갔다.

영국 랭카스터대와 미국 버클리캘리포니아대(UC버클리) 연구진은 최신 소프트웨어로 합성한 얼굴과 실제 얼굴을 놓고 실시한 실험에서 사람들이 합성 얼굴과 실제 얼굴을 구별하지 못하는 것으로 나타났다고 미 국립과학원회보(PNAS)에 발표했다. 컴퓨터로 생성한 가상의 얼굴이 너무나 그럴듯해 구별 방법을 교육받은 사람조차 깜빡 속아 넘어갔다.

연구진이 사용한 인공지능 알고리즘은 엔비디아(Nvidia)의 생성적 대립신경망(GAN) 소프트웨어 ‘스타일갠2’(StyleGAN2)였다. 생성적 대립신경망은 실제를 흉내내는 신경망과 이를 판별해내는 신경망이 서로 경쟁하면서 실제와 똑같은 가짜를 만들어내는 컴퓨터 학습 방식을 말한다. 2014년 등장한 이후 급속히 확산하면서 각종 성인물과 가짜뉴스에 횡행하는 딥페이크의 대표적인 기술로 자리잡았다.

동전 던지기 확률과 엇비슷한 적중률

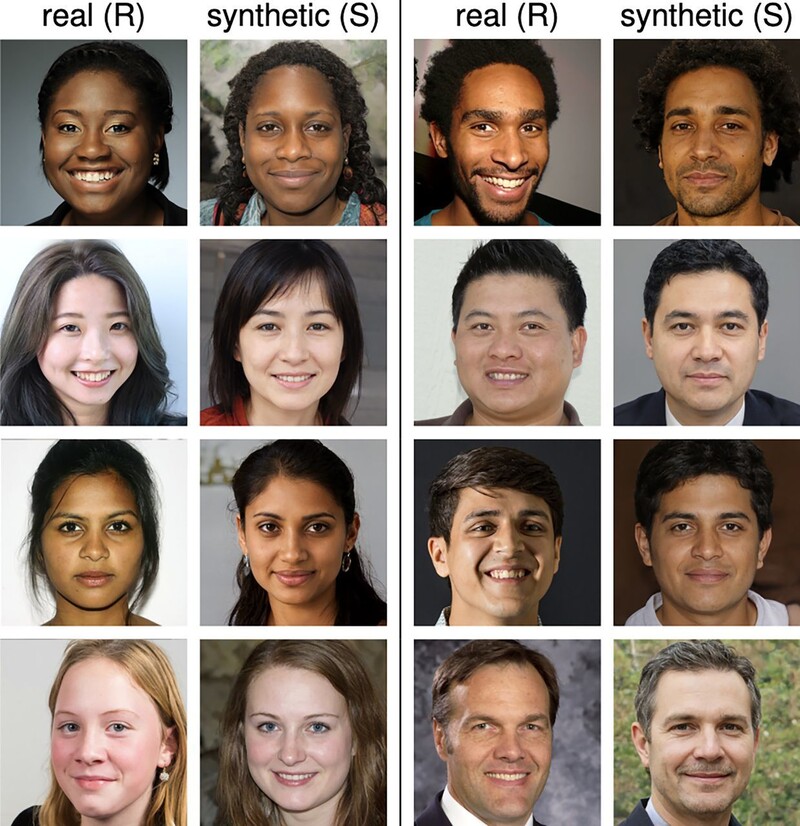

연구진은 이 소프트웨어를 이용해 몇가지 실험을 했다. 연구진은 우선 합성 얼굴과 실제 얼굴 사진 400장씩으로 실험용 데이터 세트를 만들었다. 각 세트는 백인, 흑인, 동아시아인, 남아시아인 얼굴 100명씩으로 구성했다.

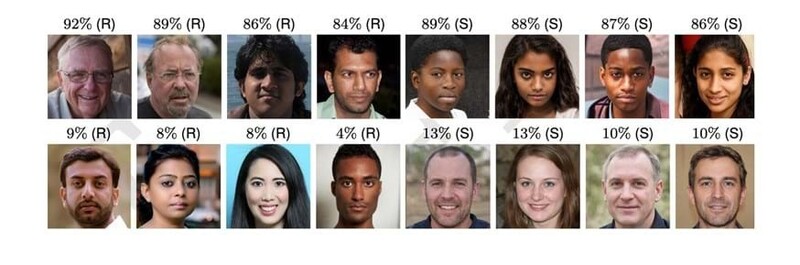

연구진은 이어 온라인을 통해 모집한 315명의 실험 참가자에게 데이터 세트에서 고른 128장의 사진을 한 장씩 보여주면서 진짜인지 가짜인지를 물었다. 참가자들의 적중률은 48.2%로 동전 던지기의 확률(50%)에 약간 못 미쳤다.

두번째 실험에선 다른 참가자 219명을 대상으로, 컴퓨터 합성 얼굴을 구별하는 법을 가르쳐주고 연습을 시킨 뒤 제1 실험 그룹과 똑같은 문제를 냈다. 이 그룹의 적중률은 59%로 다소 높았다. 연구진은 그러나 연습을 더 많이 한다고 해서 적중률이 더 높아지지는 않았다고 밝혔다.

인종별로 적중률을 나눠 살펴본 결과, 진짜와 가짜를 구별하기 가장 어려운 얼굴은 백인이었다. 이는 소프트웨어가 백인 얼굴로 더 많은 훈련을 했기 때문일 것으로 연구진은 추정했다.

가장 믿을 만하다고 생각한 얼굴 3명 모두 가짜

사람들은 아주 짧은 순간 얼굴을 보는 것만으로도 그 사람이 믿을 만한 사람인지 아닌지와 같은 개인의 특성을 추론해낸다. 연구진은 합성 얼굴도 사람의 신뢰성에 대한 판단을 이끌어낼 수 있는지 궁금했다. 만약 그렇지 않다면 신뢰성에 대한 인식은 진짜와 가짜를 구별하는 하나의 기준이 될 수 있기 때문이다.

연구진은 얼굴에서 느끼는 신뢰성 정도를 가짜 얼굴을 구별하는 기준으로 삼을 수 있는지 알아보기 위해 세번째 실험을 했다.

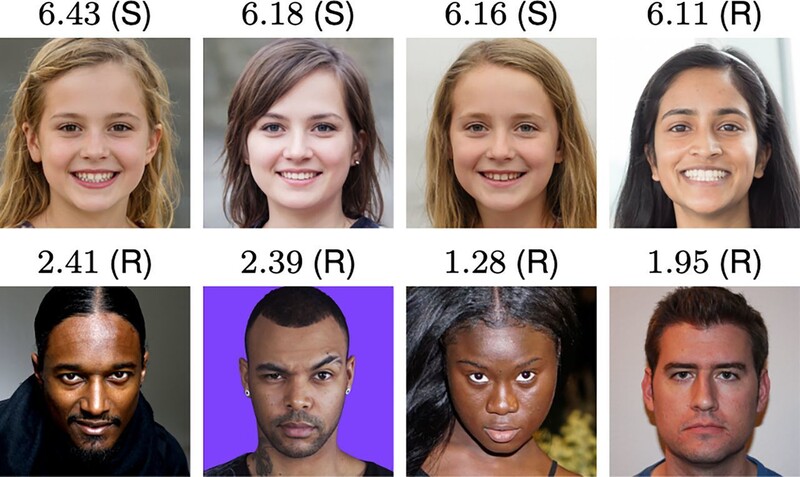

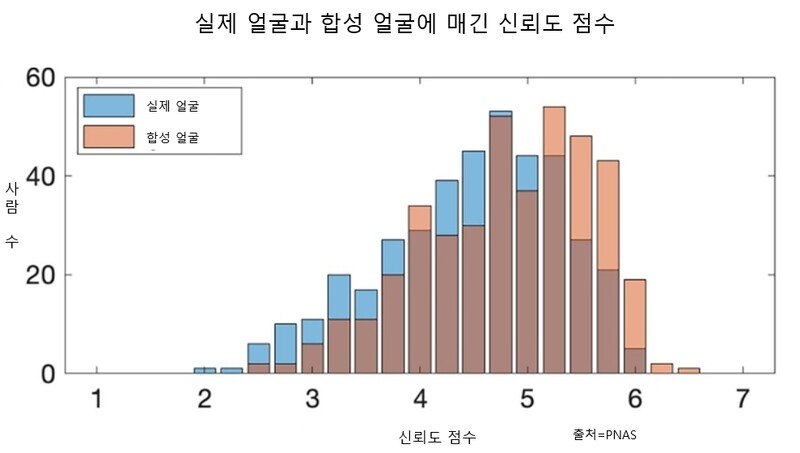

연구진은 223명의 참가자로 구성된 또 다른 그룹에 똑같은 얼굴을 보여주고 신뢰성을 평가해 1점(매우 불신)에서 7점(매우 신뢰)까지 매기도록 요청했다. 결과는 놀라웠다. 참가자들은 진짜보다 가짜 얼굴에 평균 8% 더 높은 신뢰 점수를 줬다. 실제 얼굴은 평균 4.48점, 합성 얼굴은 4.82점을 받았다.

참가자들이 가장 믿을 수 없다고 생각한 얼굴 4명은 진짜, 가장 믿을 만하다고 생각한 얼굴 3명은 가짜였다.

이유가 뭘까? 혹시 합성 얼굴에 웃는 표정이 더 많아서일까? 그러나 웃는 표정의 비율은 실제 얼굴(65.5%)보다 합성 얼굴(58.8%)이 더 적었다. 표정만으로는 이 현상을 설명할 수 없다는 뜻이다.

연구를 이끈 랭카스터대의 소피 나이팅게일 박사는 “사람들은 전형적인 얼굴을 더 신뢰할 가능성이 높은데, 합성 얼굴이 ‘평균적인’ 사람의 얼굴에 더 가깝기 때문일 수 있다”고 말했다. 참고로 여성이 남성보다 더 높은 신뢰 점수를 받았다.

모든 기록물이 의심받는 사태 올 수도

연구진은 “인공지능이 합성한 얼굴에 대한 사람들의 평가는 이제 합성 엔진이 ‘언캐니 밸리’(Uncanny valley, 불쾌한 골짜기란 뜻)를 지나쳐 실제 얼굴보다 더 그럴듯한 얼굴을 만들 수 있음을 가리킨다”고 밝혔다. ‘언캐니 밸리’란 사람의 모습과 비슷하지만 조잡한 로봇을 보고 사람들이 불쾌감을 느끼는 현상을 말한다. 이번 실험에서 보여준 사람들의 반응은 지금의 딥페이크 기술은 그런 단계를 벗어나도 한참이나 벗어났음을 말해준다.

실제와 합성 이미지를 구별하지 못하는 현실은 심각한 결과를 초래할 수 있다.

나이팅게일은 “이런 합성 얼굴은 음란 성인물이나 사기와 같은 사악한 목적을 실현하는 데 매우 효과적”이라며 “이를 이용해 남에게 해를 입히려는 사람들이 반드시 있는 만큼 더 엄격한 윤리 지침과 법규가 필요하다”고 말했다.

그는 위험을 줄이기 위해 개발자들이 사진에 워터마크를 붙이는 것을 해법의 하나로 제시하고 “그런 조처를 하지 않는다면 상황이 더 나빠질 것”이라고 강조했다.

가짜 이미지와 영상이 걷잡을 수 없이 확산하면서 모든 기록물의 진위가 의심받는 사태가 초래될 수 있다는 것이다.

곽노필 선임기자 nopil@hani.co.kr

원문: https://www.hani.co.kr/arti/science/technology/1031448.html

'[IT 알아보기] > IT 소식' 카테고리의 다른 글

| [IT 소식] [취재수첩] 애플, 메타 추락 '타산지석' 삼아야 (0) | 2022.02.19 |

|---|---|

| [IT 소식] 애플, 배우자 위치 추적 스마트 결혼 반지 '아이 링' 개발하나? (0) | 2022.02.18 |

| [IT 소식] 미래의 개인 맞춤 의료보조자, 카디오그램의료 서비스 (0) | 2022.02.18 |

| [IT 소식] SK하이닉스, 스마트 메모리 개발…'연산·저장 한번에' (0) | 2022.02.17 |

| [IT 소식] 두 팔로 달 탐사하는 ‘켄타우로스’ 로봇 개발 (0) | 2022.02.17 |